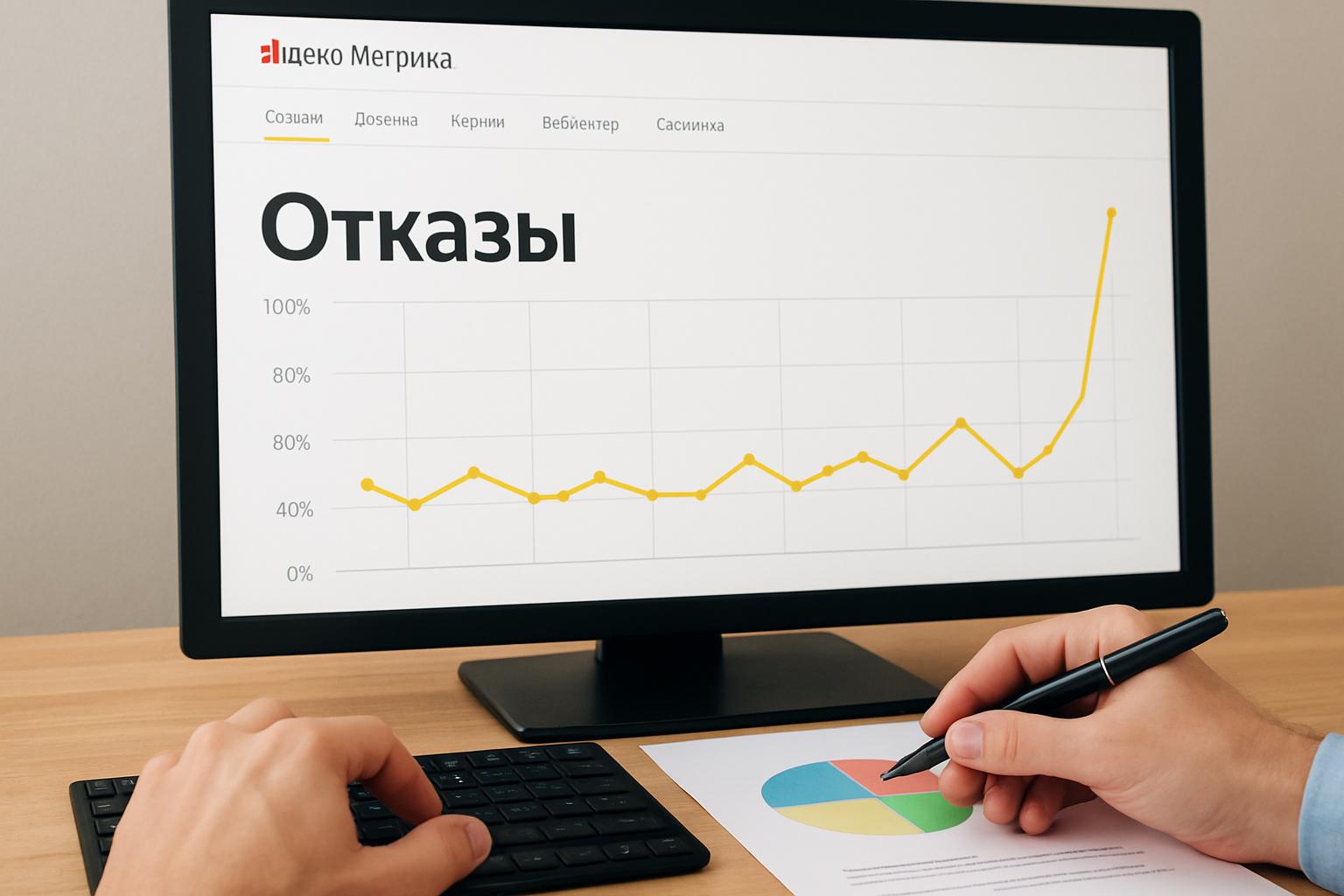

Первые тревожные сигналы появляются внезапно: рост отказы, снижение глубины просмотра и непонятный всплеск трафика из непрофильных стран. В таких ситуациях невольно возникает вопрос: Как понять что отказы в Яндекс Метрике генерируют боты? Эта статья — подробный практический гид: признаки, инструменты, пошаговый план расследования и конкретные действия для борьбы с ложными сессиями.

Понимаем, что такое «отказы» в контексте Яндекс.Метрики

В Метрике под «отказом» обычно подразумевают сессию с одной просмотренной страницей и без действий, которые вы отслеживаете как цели. Это может быть настоящий пользователь, который не нашёл нужной информации, или автоматический агент, выполняющий однокадровый запрос. Различение этих случаев критично для корректных выводов по SEO и конверсии.

Важно помнить, что сама по себе высокая доля отказов не всегда плохая метрика. Для целевых посадочных страниц с формой или для страниц с чёткой задачей одностраничная сессия может быть нормой. Однако если при этом падают конверсии из поиска и видимость сайта страдает, нужно копать глубже.

Почему боты мешают SEO аналитике и бизнес-решениям

Искажение данных затрудняет оценку эффективности SEO продвижение и поисковой оптимизации. Если в отчётах виден рост трафика, но при этом нет роста позиций сайта и конверсий, вероятно, часть этого трафика — «мёртвые» визиты машин.

Ошибочная интерпретация таких цифр может привести к неверной SEO стратегии: инвестировать в неэффективные каналы, корректировать семантику без причины или неправильно оценивать видимость сайта в выдаче. Поэтому задача — отделить органический трафик от искусственно сгенерированных сессий.

Типы ботов, которые попадают в Метрику

Не все боты одинаковы. Одни — поисковые краулеры (белые боты), которые индексируют страницы; другие — зловредные или «шумовые» роботы, создающие фальшивые просмотры и реферальный спам. Третьи — мониторинговые системы или скрипты конкурентного анализа, которые симулируют простые заходы на страницу.

Отличие по поведению помогает их распознать: поисковые боты часто обходят сайт по карте и соблюдают robots.txt, тогда как шумовые боты делают множественные быстрые запросы, переходы по странным URL и оставляют необычные User-Agent. Оценка этих паттернов — ключ к диагностике.

Признаки того, что отказы генерируют боты

Наблюдать нужно сочетание сигналов: резкие всплески трафика без реального роста бизнес-результатов, однотипные User-Agent, странная география, нулевые глубины просмотра и аномально короткая продолжительность сессий. Каждый из этих признаков сам по себе не окончательный, но в совокупности они дают ясную картину.

Ниже перечислены конкретные индикаторы и их интерпретация. Это поможет быстро отделить «шум» от живых пользователей и понять, какие данные в SEO отчетах стоит пересматривать.

Временные аномалии и резкие всплески

Если график посещений показывает резкий рост в определённый час или день, а при этом конверсии или поисковый трафик не растут, это повод подозревать бот-активность. Такие всплески часто приходят пакетно и совпадают с сетевыми сканированиями.

Также стоит обратить внимание на стабильные однотипные пики — несколько дней подряд в одно и то же время. Человеческая активность так не ведёт себя, её характер более хаотичен.

Распределение по географии и провайдеру

Если значительная часть отказов приходит из стран, которые не являются целевыми для бизнеса, или IP-адреса принадлежат хостерам и дата-центрам, а не конечным пользователям, это сильный сигнал в пользу ботов. Особенно подозрительно, когда регион массово отображается как «не определён».

Анализ провайдеров помогает: массовые заходы от cloud-провайдеров, VPN-операторов и хостингов обычно свидетельствуют о машинных запросах, а не о реальной аудитории.

User-Agent и технические признаки

Некоторые боты выставляют пустой или стандартный User-Agent; другие маскируются под браузеры, но при этом не загружают ресурсы страницы. Проверка User-Agent в сочетании с хедерными параметрами и поведением (например, отсутствие загрузки JS) указывает на автоматизацию.

Проверяйте также обращения к файлам robots.txt и sitemap. Поисковые роботы сначала считывают эти файлы. Если вы видите массовые запросы к бессмысленным страницам и при этом нет обращений к sitemap, это подозрительно.

Странное поведение на странице

Боты часто совершают только один запрос: страницу, затем уходят. Они не выполняют кликов, не загружают динамические элементы, не взаимодействуют с формами. Если у вас включён Webvisor, такие сессии легко отличить: отсутствие движений мыши, скролла и кликов.

Особенно показательно, когда боты посещают страницы с низким приоритетом: страницы ошибок, технические урлы, страницы пагинации. Это отличается от поведение живого пользователя, который обычно ориентируется по контенту.

Источники трафика и реферальный спам

Всплески трафика с необычных рефералов, массовые заходы через прямые заходы с пустыми реферролами или редиректы из подозрительных доменов — классическая схема. Такие рефералы часто приводят ботов, которые генерируют «пустые» сессии и завышают показатель отказов.

Важно фильтровать стоп-лист рефереров и анализировать детали кампаний, чтобы не путать с реальным реферальным трафиком, приходящим от партнёров.

Таблица признаков и рекомендованных порогов для первой оценки

| Индикатор | Что наблюдается | Практический порог для подозрения |

|---|---|---|

| Резкий рост визитов | Всплеск на 50%+ за пару часов без конверсий | Рост визитов >50% при падении конверсий |

| Доля отказов | Скачок до 80-100% на отдельных страницах | Отказы >80% + низкая глубина просмотра |

| Средняя длительность сессии | Меньше 5 секунд для большинства сессий | < 10 секунд — повод исследовать |

| География | Массовые заходы из нецелевых стран | Более 30% от нецелевых регионов |

| User-Agent | Пустые или однотипные UA, масса «-» или «python-requests» | Более 10-15% с идентичными UA |

Пошаговый план расследования

Для системного подхода подготовьте чек-лист и действуйте по шагам: сначала инструкция по быстрому выявлению аномалий, затем детальное исследование и реализация фильтров. Такой план помогает не упустить ничего важного и избежать поспешных блокировок полезного трафика.

-

Соберите базовые данные: графики посещаемости, источники, гео, User-Agent и время на странице. Сравните с предыдущими периодами и тот же день недели.

-

Выделите сегменты с аномалиями и включите Webvisor, если он доступен, чтобы просмотреть живые сессии.

-

Проверьте серверные логи и access.log на совпадение по IP, времени и User-Agent. Сервера дают более точные данные, чем только клиентская аналитика.

-

Идентифицируйте IP-диапазоны и хостинг-провайдеров, откуда идут подозрительные запросы.

-

Создайте тестовый фильтр в Яндекс.Метрике, чтобы исключить подозрительные сессии и посмотреть, как изменятся метрики.

-

Уточните по robots.txt, не окажется ли, что нужный бот просто неправильно настроен, и не стоит его блокировать.

-

При необходимости примените серверные правила блокировки или rate-limiting и наблюдайте эффект на данные в Метрике.

-

Задокументируйте выявленные паттерны и настройте регулярный мониторинг, чтобы повторные атаки выявлялись быстрее.

Как использовать возможности Яндекс.Метрики для фильтрации ботов

Метрика предлагает несколько инструментов для чистки данных: фильтры представлений, исключения по IP, сегменты и цели. При грамотном применении они позволяют отфильтровать большую часть шумовых сессий прямо в интерфейсе.

Создайте сегменты «Подозрительные визиты» и «Живая аудитория» и сравните их поведение. Это позволит оценить истинное качество поискового трафика и корректно строить SEO отчеты и выводы о росте трафика и видимости сайта.

Фильтрация по IP и User-Agent

Прямое исключение IP-диапазонов из отчётов — быстрый и понятный способ, но он требует аккуратности. Перед блокировкой перепроверьте, не относятся ли IP к легитимным сервисам, например индексаторам поисковиков.

Фильтрация по User-Agent работает, если боты не маскируются под реальные браузеры. Комбинация IP + UA даёт лучший эффект и снижает риск ошибочной фильтрации.

Сегменты и цели вместо грубой фильтрации

Если вы не уверены в источнике трафика, лучше создать сегменты и ставить цели на реальные действия пользователей. Это помогает сохранить сырые данные для архива и одновременно получать корректные отчёты по живой аудитории.

Например, цель «заполнение формы» и сегмент «визиты с заполнением» покажут, как изменяется конверсия из поиска именно у людей, а не у роботов.

Серверные методы и защита на уровне инфраструктуры

Клиентская фильтрация — не единственный уровень защиты. Серверные логи обычно содержат больше подробностей: точные URL, тайминги, количество запросов от IP и заголовки. Анализ логов помогает ставить блокировки и корректно настраивать CDN.

Рекомендуемые меры: rate-limiting, использование CDN с встроенной защитой, правила WAF, блокировка по ASN, и при необходимости — настройка honeypot-страниц, чтобы идентифицировать сканирующие боты.

Примеры правил и инструментов

Rate-limiting на Nginx, fail2ban для автоматической блокировки по частым ошибкам и Cloudflare/Яндекс.Облако с функциями WAF — стандартный набор. Комбинация правил на уровне приложения и на уровне сети даёт максимальный эффект.

Не забывайте про reCAPTCHA и проверку форм: большое количество пустых отправок форм часто указывает на автоматизацию, и CAPTCHA решает проблему у источника.

Как адаптировать SEO-аналитику и отчёты после фильтрации

Когда вы начинаете фильтровать ботов, сырые показатели трафика могут резко упасть. Это нормально: важно, чтобы оставшиеся данные отражали реальное поведение аудитории. Переструктурируйте SEO отчёты, выделив чистый поисковый трафик и показатели, влияющие на ранжирование и видимость сайта.

При составлении SEO стратегии учитывайте, что рост трафика без роста конверсий и улучшения позиций сайта неважен. Фокусируйтесь на показателях качества: глубина просмотра, время на странице, конверсии из поиска и рост позиций в выдаче.

Практический пример из моей практики

Однажды у клиента вырос трафик на 70% за неделю, но конверсии почти не изменились. Первый анализ показал странные пики ночью и множество заходов с пустыми User-Agent. Я включил Webvisor и увидел, что сессии не содержат кликов и скролла.

Дальнейшая проверка server logs подтвердила массовые запросы от парочки ASN. Мы временно исключили эти диапазоны в Метрике, настроили rate-limiting и добавили правило на уровне CDN. Через двое суток метрики очистились, а органический трафик и конверсии стали адекватно отражать реальную ситуацию.

Какие метрики пересмотреть, чтобы не заблуждаться

После очистки важно переключиться с общих чисел на качественные метрики. Следите за конверсиями из поиска, средней глубиной просмотра, временем на странице и показателями возвратов. Эти значения дают представление о том, насколько аудитория заинтересована в контенте.

Сравнивайте показатели до и после фильтрации и фиксируйте изменения в SEO аналитике. Это поможет оценить реальный эффект от мероприятий и скорректировать SEO стратегию в долгосрочной перспективе.

Типичные ошибки при борьбе с ботами

Часто допускают две крайности: либо ничего не делать, либо агрессивно блокировать всё подряд. Первая позиция оставляет аналитику и отчёты испорченными, вторая — рискует отрезать полезных индексаторов или партнерские сервисы. Баланс — основное правило.

Ещё одна ошибка — полагаться только на User-Agent. Современные боты маскируют UA и используют распределённые IP. Поэтому комбинируйте признаки: IP, поведение, гео и логи сервера.

Инструменты и сервисы, которые помогут

Для постоянного мониторинга и автоматизации используйте сочетание внутренних и внешних инструментов: Яндекс.Метрика и Webvisor, анализ серверных логов через ELK, Cloudflare или Яндекс.Облако для защиты, fail2ban и WAF для блоков на сервере. Специализированные сервисы по детекции ботов также полезны для крупных проектов.

-

Яндекс.Метрика — для сегментации, целей и Webvisor.

-

Серверные логи + ELK/Graylog — для глубокого анализа и кросс-проверки.

-

CDN с WAF — для блокировки на уровне сети.

-

Fail2ban и правила Nginx — для автоматической фильтрации по частоте запросов.

-

Сервисы распознавания ботов — для корпоративных проектов с высоким трафиком.

Как это отражается на задачах по росту позиций и видимости сайта

Качество трафика напрямую влияет на показатели ранжирование и отображение сайта в выдаче. Если метрика показывает рост трафика, но снижает конверсии и среднее время на сайте, это отрицательно сказывается на оценках поведения поисковых систем.

Поэтому в рамках поисковой оптимизации и SEO продвижение стоит ориентироваться на метрики, которые отражают вовлечённость и конверсии, а не только на количество визитов. Рост трафика без роста позиций и конверсий — ложный успех.

Контроль и план действий на будущее

Организуйте регулярный аудит сайта, включая технический аудит и проверку аналитики. Настройте оповещения о резких изменениях в количестве отказов и трафике, чтобы реагировать быстро. Постоянный мониторинг — залог стабильных и корректных данных для принятия решений.

Кроме того, документируйте все фильтры и правила, чтобы новые члены команды или подрядчики понимали, какие изменения были сделаны и почему. Это упростит последующие аудиты и позволит точнее интерпретировать результаты SEO аналитики.

Подводя итог, важно действовать системно и не пытаться «лечить» симптомы. Комбинация клиентских и серверных данных, тестовых фильтров в Яндекс.Метрике и инфраструктурных мер защиты позволит отличить живую аудиторию от бот-шума. Стабильно чистая аналитика даст возможность принимать обоснованные решения по SEO стратегии, гибко управлять видимостью сайта и добиваться реального роста позиций и конверсий из поиска.