Разговор о рендеринге сегодня затрагивает не только инженеров. Владельцы сайтов, маркетологи и SEO специалисты сталкиваются с выбором: отдавать браузеру работу по отрисовке или генерировать HTML на сервере. От этого выбора зависят скорость загрузки, поведение поисковых роботов и, в конечном счете, видимость сайта в результатах поиска.

В этой статье разберём на практике, какие плюсы и минусы несёт каждый подход, как они отражаются на поисковой оптимизации и какие шаги помогут минимизировать риски. Материал ориентирован на тех, кто принимает решения о архитектуре фронтенда и хочет понимать последствия для органического трафика и позиций сайта.

Понятие серверного и клиентского рендеринга

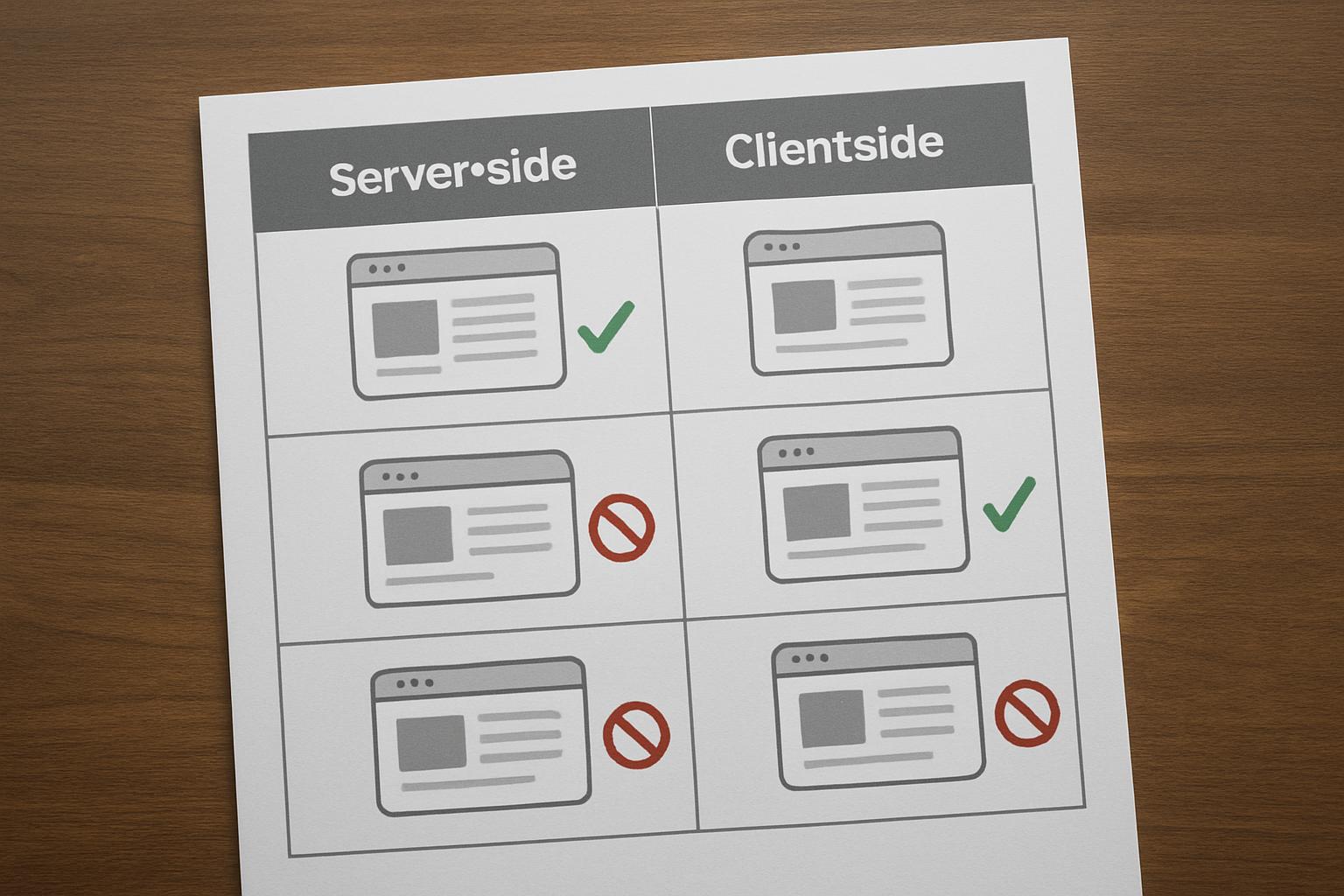

Серверный рендеринг означает, что HTML формируется на сервере и отправляется готовой страницей пользователю. Браузер получает страницу с содержимым, и пользователю виден полный документ почти сразу. Такой подход традиционно считается благоприятным для индексации и быстрой отдачи контента.

Клиентский рендеринг предполагает отправку пустой оболочки страницы и JavaScript, который в браузере строит DOM и подставляет содержимое. Этот метод позволил создавать динамичные интерфейсы и приложенческую логику, но накладывает требования на работу с JavaScript и процесс индексации.

Кроме этих двух полюсов существуют гибридные модели: предрендеринг статических страниц, инкрементальная генерация, серверная отрисовка с последующей гидрацией. Они стремятся сочетать преимущества обеих стратегий и уменьшить недостатки.

Как поисковые роботы видят страницы

Поисковые системы обрабатывают HTML и исполняют JavaScript по-разному. Современные движки, например Googlebot, умеют выполнять скрипты, но это происходит в отдельной очереди и занимает больше времени. До выполнения JavaScript робот может увидеть только минимальный HTML.

Если контент целиком зависит от клиентского рендеринга, есть риск, что поисковый бот не успеет корректно обработать страницу, и часть важной информации останется невидимой. Это отражается на ранжировании и видимости сайта в поиске.

Важно учитывать, что не все поисковые роботы одинаковы. Некоторые сторонние индексаторы и социальные сети менее терпимы к JS-ориентированным страницам. При работе над поисковой оптимизацией это нужно держать в голове.

Индексация, ранжирование и видимость сайта

Индексация — процесс, при котором робот добавляет страницу в индекс. Рендеринг влияет на то, что именно попадёт в индекс: содержимое, мета-теги, структурированные данные. Серверный рендеринг обычно даёт предсказуемый результат, поскольку HTML сразу содержит всю значимую информацию.

Ранжирование зависит от множества факторов, но поисковые алгоритмы учитывают доступность и полноту контента. Если критические элементы, которые определяют релевантность, формируются только на клиенте, это может ослабить сигнал и ухудшить позиции сайта.

Видимость сайта и рост трафика тесно связаны с тем, насколько быстро и корректно поисковая система видит контент. Чем меньше препятствий на пути робота к содержимому, тем выше шанс получить стабильный поток поискового трафика.

Производительность и пользовательский опыт: связь с SEO

Core Web Vitals и другие метрики производительности формируют параметры ранжирования. Время до первого meaningful paint, interactivity и стабильность визуального контента напрямую влияют на поведение пользователей и сигналы вовлечённости. Серверный рендеринг часто выигрывает по показателям первого отрисовки, что положительно сказывается на SEO продвижении.

Клиентский рендеринг может создать ощущение «пустой страницы» до завершения загрузки JavaScript, что ухудшает поведенческие метрики и конверсии из поиска. При слабом соединении или медленных устройствах проблема становится острее.

Гибридные подходы помогают: отправлять минимальный, но важный контент с сервера и догружать интерактивность на клиенте. Это баланс производительности и функциональности, который часто оказывается оптимальным для поисковой оптимизации.

Технические аспекты: гидрация, предрендеринг, динамический рендеринг

Гидрация — процесс, когда серверный HTML становится интерактивным после того, как клиент загрузит JavaScript. Она позволяет совмещать быстрый видимый контент и богатую клиентскую логику. Однако гидрация накладывает дополнительные требования на объём передаваемого кода и порядок инициализации скриптов.

Предрендеринг (static site generation) генерирует страницы на этапе сборки и идеально подходит для контента, который редко меняется. Такой сайт максимально дружелюбен к поисковым системам и часто демонстрирует стабильный рост позиций без сложной инфраструктуры.

Динамический рендеринг — стратегия, при которой сервер определяет, является ли посетитель роботом, и отдает ему уже отрендеренный HTML, а обычным пользователям — SPA. Это компромисс, но его нужно использовать осторожно, чтобы не вводить разночтение контента, что может вызвать вопросы у поисковых систем.

Когда стоит выбирать гидрацию

Гидрация оправдана, если требуется сложная интерактивность и динамические интерфейсы, но важный контент должен быть видимым сразу. В этом случае сервер отдаёт базовый HTML, а клиент делает страницу живой. Такой подход уменьшает риск потери релевантного содержимого в индексе.

Нужно внимательно управлять объемом JavaScript, чтобы не ухудшить скорость. Разделение кода, ленивые модули и критические inline-скрипты помогут держать время загрузки под контролем и сохранить эффективность поисковой оптимизации.

Типичные ошибки при CSR и их последствия для SEO

Одна из распространённых проблем — рендеринг важного текста только через клиентские запросы к API, которые не выполняются при индексации. В результате в индексе оказываются пустые или частично заполненные страницы. Это неминуемо бьёт по позиции сайта в выдаче.

Ещё одна ошибка — неправильно настроенные мета-теги и заголовки, которые динамически вставляются, но не попадают в начальный HTML. Поисковые роботы могут не увидеть эти метаданные и неправильно оценить страницу.

Кэширование JavaScript без продуманной стратегии обновления приводит к тому, что поисковик видит устаревший контент. Это особенно критично для сайтов с часто меняющейся информацией и для SEO стратегии в целом.

Практическая таблица: сравнение подходов

| Подход | Индексация | Производительность | Сложность внедрения |

|---|---|---|---|

| Серверный рендеринг (SSR) | Высокая, контент виден сразу | Хорошая для первых отрисовок | Средняя — требует серверной логики |

| Клиентский рендеринг (CSR) | Рискованно, зависит от JS | Может быть хуже при медленном JS | Низкая с точки зрения сервера, высокая по фронтенду |

| Предрендеринг (SSG) | Отлично, статические HTML | Очень быстро для пользовательского опыта | Низкая, если контент стабильный |

Работа с метаданными и структурированными данными

Мета-теги, Open Graph, структурированные данные типа schema.org — это те элементы, которые поисковые системы и агрегаторы читают напрямую из HTML. Если они добавляются только скриптом после загрузки, риск их пропуска велик. Серверный рендеринг обеспечивает их стабильное присутствие.

Для сайтов на CSR стоит применять серверные шаблоны или динамическое заполнение на сервере хотя бы для ключевых мета-элементов. Это повышает точность представления страницы в выдаче и улучшает отображение в сниппетах.

Структурированные данные особенно важны для улучшения видимости и получения расширенных сниппетов. Их корректная интеграция должна стать частью технического аудита перед релизом крупного изменения интерфейса.

Кеширование и CDN: ускоряем отдачу HTML и ресурсов

Независимо от подхода к рендерингу, правильное кеширование и использование CDN ускоряют доставку контента пользователям и поисковым роботам. Для SSR это особенно важно, так как сервер генерирует HTML на лету и нагрузка может быть высокой.

Для CSR CDN помогает быстрее доставлять скрипты и ассеты, но если логика рендера тяжёлая, преимущества будут ограничены. Подстройка TTL и инвалидация кеша при обновлениях — критичные аспекты, которые часто упускают из вида при воплощении SEO стратегии.

Важно тестировать поведение кеша с учётом роботов: иногда стоит отдавать для ботов более свежую или специально подготовленную версию страниц. Такие меры должны быть прозрачны и обоснованы в SEO отчётах.

Инструменты для проверки и мониторинга

Для оценки влияния рендера на поисковую оптимизацию подойдут Lighthouse, Search Console, Screaming Frog и инструменты APM. Они позволяют увидеть, что именно индексируется, каковы метрики производительности и где есть узкие места. Эти данные формируют базу для технического аудита.

SEO аналитика должна быть регулярной: сравнение до и после изменений показывает реальное влияние на рост трафика и позиции сайта. Без метрик сложно судить о том, была ли выбранная архитектура удачной.

Отчёты по Core Web Vitals, скорости загрузки и покрытию индекса в Search Console — первое, что стоит включить в ежемесячный список контрольных точек для проверки результатов оптимизации.

Аудит сайта и технический аудит при смене рендера

Перед сменой стратегии рендеринга необходим аудит сайта. Нужно проверить доступность критического контента, корректность метатегов, наличие структурированных данных и поведение клиентских скриптов при эмуляции роботов. Такой аудит минимизирует риски падения позиций сайта после релиза.

Технический аудит следует разделить на этапы: тестирование на staging, анализ логов роботов, оценка производительности и тест на кэширование. Это позволит увидеть узкие места до выката в продакшн и подготовить план отката, если что-то пойдёт не так.

Также полезно включить в аудит проверку серверных ответов, заголовков кэширования и корректности реализации canonical. Малозаметные ошибки в этих местах часто приводят к проблемам с индексацией и потерям поискового трафика.

Примеры из практики: что я видел на проектах

В одном из проектов, над которым я работал, фронтенд был полностью CSR, и команда решила перейти на SSR для ключевых страниц. После релиза первые положительные изменения проявились в улучшении показателей «времени до первого meaningful paint» и в лучшем отображении страниц в сниппетах. Это привело к постепенному росту органического трафика.

Другой случай показал обратную сторону. При попытке внедрить динамический рендеринг для всех страниц команда недостаточно протестировала кэширование, и роботы получали неактуальный контент. Потребовался откат и повторный технический аудит, чтобы восстановить позиции сайта.

Эти случаи подчёркивают: техническая аккуратность важнее громких решений. Плавные изменения и тщательные тесты дают больше шансов на устойчивый рост позиций.

Контроль качества: чек-лист перед релизом

Перед переводом сайта на другую модель рендеринга стоит пройти по чек-листу. В нём должны быть пункты по проверке доступности метаданных, корректности структурированных данных, времени загрузки, кешированию и поведению при эмуляции робота.

Ниже — базовый чек-лист, который можно использовать как отправную точку:

- Проверить, что ключевой контент видим в исходном HTML для роботов.

- Убедиться в корректности мета-тегов и заголовков, отображаемых в исходном HTML.

- Проверить работу schema.org и других структурированных данных.

- Промерить Core Web Vitals до и после изменений.

- Настроить и проверить правила кеширования и инвалидации CDN.

- Провести нагрузочное тестирование сервера при SSR-сценариях.

Как интегрировать SEO стратегию с выбором рендера

Выбор рендера — часть общей SEO стратегии. Он должен соответствовать целям: быстрый рост позиций в конкурентной нише потребует внимания к скорости и доступности контента, а сложные веб-приложения потребуют компромиссов, чтобы не потерять поисковый трафик.

Важно включить разработчиков и SEO-специалистов в одну коммуникационную цепочку. Совместное принятие решений по тому, какие части сайта должны быть статичными, а какие интерактивными, уменьшит риски и оптимизирует конверсии из поиска.

Регулярные SEO отчёты с показателями видимости сайта, ростом трафика и позиций дадут менеджерам чёткое представление о том, работает ли выбранная архитектура в пользу бизнеса.

Советы по выбору: когда SSR, когда CSR, а когда гибрид

SSR рекомендован для сайтов с большим объёмом контента, который важен для индексации и сниппетов. Это магазины с каталогами, новостные ресурсы и лендинги, где первичный контент определяет поисковые запросы. Такой подход повышает шансы на стабильное ранжирование.

CSR подойдёт для сложных одностраничных приложений, где взаимодействие пользователя превыше SEO-целей. Однако даже в таких проектах стоит отдавать с сервера хотя бы ключевые элементы страницы, чтобы не лишать сайт поискового трафика.

Гибриды и SSG — золотая середина для многих сайтов: быстрый пользовательский опыт и хорошая индексация. Они позволяют достигать роста позиций без серьёзных компромиссов в функциональности.

Мониторинг после изменений: как понимать эффективность

После релиза новой модели рендеринга следует внимательно отслеживать SEO метрики. Начать стоит с Search Console: изменения в покрытии индекса, ошибки рендера и производительности. Далее — аналитика по органическому трафику и поведенческим метрикам.

SEO аналитика должна показывать не только общие тренды, но и детализацию по страницам. Если отдельные группы страниц потеряли позиции, их нужно быстро изолировать и проанализировать причины. Быстрая реакция ограничит возможные убытки в трафике и конверсиях.

Периодически возвращайтесь к техническому аудиту и обновляйте SEO отчёты. Это даст картину долгосрочного влияния архитектурных решений на рост трафика и конверсии из поиска.

Практические рекомендации для разработчиков и SEO специалистов

Работайте над тем, чтобы критический контент был доступен роботу без исполнения JavaScript. Это минимизирует риск потери релевантности при индексации и улучшит видимость сайта в выдаче. Внедряйте это правило как технический стандарт проекта.

Разделяйте код, чтобы не грузить пользователя лишними скриптами. Ленивые загрузки, code splitting и критический inline обеспечивают баланс между интерактивностью и скоростью. Такие техники помогают удерживать позиции сайта и поддерживать качественный пользовательский опыт.

Документируйте изменения и фиксируйте результаты в SEO отчётах. Подход «сделали и забыли» редко работает в долгосрочной оптимизации. Регулярные отчёты помогут выявить тренды и скорректировать SEO стратегию.

Кому доверять реализацию и как оценивать подрядчика

При выборе подрядчика обращайте внимание на портфолио: есть ли у команды опыт в проектах с похожими требованиями по индексации и производительности. Запросите примеры аудитов и отчётов, чтобы понять качество работы и глубину аналитики.

Требуйте тестовый план и сценарии отката при внедрении новых подходов к рендерингу. Это снизит риск для поискового трафика и позволит вернуть прежнюю работу сайта в случае проблем. Прозрачность и контроль — ключевые параметры хорошего партнёра.

Также важно, чтобы подрядчик умел работать в команде с SEO специалистами и маркетингом, а не только с разработчиками. Только совместная работа обеспечивает баланс между техническими решениями и бизнес-целями.

Финальные практические шаги перед изменением

Сделайте резервный план: поэтапный rollout, мониторинг ключевых показателей и возможность быстрого отката. Это уменьшаёт риск длительных просадок органического трафика и позиций сайта. Чем чище и проще план, тем больше шансов на бесшовный переход.

Проведите A/B тестирование критических страниц, если это возможно. Сравните поведение пользователей и позиции в поиске при разных подходах к рендерингу. Эксперименты дают конкретные ответы на вопрос, что лучше именно для вашего проекта.

Помните, что SEO продвижение — это не разовое действие, а постоянный процесс. Технические решения по рендерингу — важная часть этого процесса, но они работают в связке с содержанием, ссылочной стратегией и аналитикой.

Короткий практический чек-лист для команды

- Обеспечить видимость критического контента в исходном HTML.

- Проверить мета-теги и структурированные данные на этапе серверного рендера.

- Настроить кеширование и CDN с учётом роботов.

- Промерить Core Web Vitals до и после релиза.

- Проводить регулярный технический аудит и анализ SEO отчётов.

- Организовать совместную работу разработчиков и SEO специалистов.

Рендеринг страниц — не магия и не приговор для SEO. При правильном подходе можно получить и быстрые страницы, и богатую интерактивность, и стабильный рост позиций. Главное — не терять из виду базовые принципы поисковой оптимизации и постоянно проверять, как технические решения отражаются на органическом трафике и конверсиях из поиска.

Если вы готовите миграцию архитектуры или изменение способа отрисовки, начните с технического аудита, составьте план тестирования и мониторинга, и держите в приоритете данные из поисковой аналитики. Такой план сократит риски и обеспечит плавный рост видимости сайта в выдаче.